1. エグゼクティブサマリー

2026-04-26(JST)にかけて、AIは「性能」だけでなく「現場で回る安全・運用」の整備が主役になった。OpenAIはPII検出・マスキング用の OpenAI Privacy Filter をオープンウェイトで公開し、プライバシーを“後付け”ではなく“最初から組み込む”流れを加速させた。加えてOpenAIは ChatGPT for Clinicians を無料提供(米国の検証済み個人向け)として提示し、ヘルスケア運用の入口を広げる。並行してNVIDIAはNIMのVLM関連ドキュメント更新を行い、導入者が変更点を追いやすい形で提供している。

2. 今日のハイライト

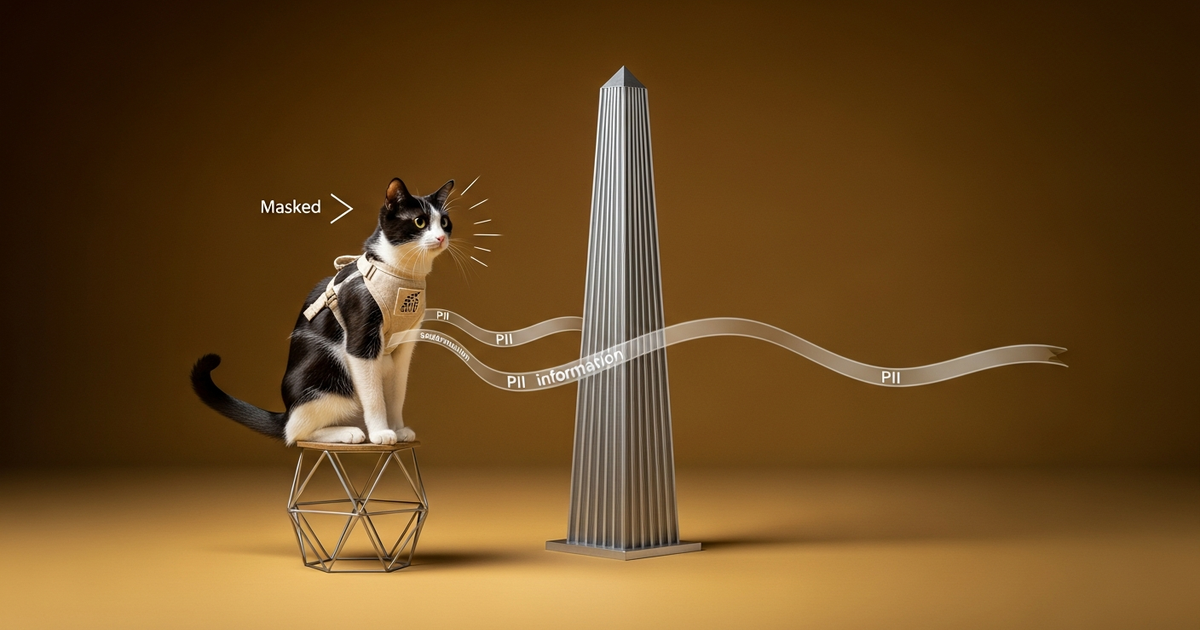

ハイライト1:OpenAI、PII検出・マスキング用「OpenAI Privacy Filter」をオープンウェイトでリリース

要約

OpenAIは、テキスト中の個人情報(PII)を検出してマスキング(またはレダクション)するための OpenAI Privacy Filter をリリースした。ローカル実行を想定した小型モデルで、高スループットなプライバシーワークフローに適用できる点を強調している。さらに、Apache 2.0ライセンスのもとで提供し、開発者が自社環境に組み込みやすい設計になっている。 (openai.com)

背景

生成AIの普及に伴い、ログ・ナレッジベース・検索インデックス・学習パイプラインなど、テキストが流通する箇所が増えた。結果として「どこでPIIが混入し、どの段階で保護すべきか」が、プロダクト設計の中核課題になっている。従来のPII検出は、メールアドレスや電話番号など形式に依存したルール中心のアプローチが多かった。一方で実運用では文脈依存の個人情報(公開情報と非公開情報の境界、曖昧な表現、記述の揺れなど)が問題になりやすい。OpenAIはPrivacy Filterを、そうした“文脈理解を伴う”PII判定を狙うモデルとして位置づけている。 (openai.com)

技術解説

Privacy Filterは、説明上「双方向のトークンクラス分類+スパンデコード」を採用し、プライバシーラベル(個人識別子、連絡先、住所、私的日付、口座/カード等のアカウント番号、APIキー・パスワードのようなシークレットなど)ごとの分類体系に基づいている。さらに推論時には、トークン予測をまとまりのあるスパンへ変換するための拘束付き(constrained)デコード手順を用いるとしている。 (openai.com) また、評価面ではPII-Masking-300kベンチマークでのF1(訂正ベンチマークを含む)や、少量のデータでのドメイン適応による改善など、実装者が期待する“精度と現場適応性”の両立を訴えている。 (openai.com)

影響と展望

このリリースの影響は、単にPIIフィルタが増えたという点にとどまらない。オープンウェイトかつローカル実行想定であるため、企業は「外部送信を伴わない保護」を設計に組み込みやすい。結果として、LLMの前処理(入力段)、保管(ログ/インデックス段)、レビュー(人手確認段)などのどこでプライバシーを担保するか、アーキテクチャ選択の自由度が上がる。 今後は、Privacy Filterを中心に「PII検出の粒度(スパン単位)」「マスキング仕様の互換性」「監査可能性(いつ・どの根拠でマスクしたか)」といった運用要件が競争軸になっていく可能性が高い。 (openai.com)

出典

OpenAI公式ブログ「Introducing OpenAI Privacy Filter」

ハイライト2:OpenAI、医療従事者向け「ChatGPT for Clinicians」を無料提供(米国・検証済み個人向け)

要約

OpenAIは ChatGPT for Clinicians をリリースし、米国内の検証済みの個人医療従事者(医師・NP・PA・薬剤師)に対して無料提供を開始した。医療分野での記録(ドキュメンテーション)や医療研究に関わる作業を支援し、臨床現場での時間不足や管理業務負荷を軽減することを狙っている。 (openai.com)

背景

医療領域では、診療そのものに加えて、事務作業・記録・コンプライアンス対応、そして日々増える医学論文・ガイドラインの追跡が“隠れたボトルネック”になりやすい。OpenAIは、米国の医療制度が強い圧力下にあること、医療従事者がAIツールに目を向けていること(2026年の調査で医師の利用が増加したという趣旨)を背景として説明している。 (openai.com) また、提供形態として「無料」「検証済み個人向け」を明確にしており、導入障壁を下げて“まず現場で試す”段階を作っている点も特徴的だ。 (openai.com)

技術解説

技術的には、ChatGPT for Cliniciansが臨床タスクに最適化された位置づけであり、提供内容としてはドキュメント作成支援や医療研究支援に焦点を当てる。加えて、リリース記事ではモデルとしてGPT‑5.4系を含む説明があり、医療タスクのベンチマーク(HealthBench)に言及している。 (openai.com) さらに、リリース前に医療アドバイザーが日常業務(臨床ケア、記録、研究)での会話を多数テストしたこと、そして会話が学習に使われない設計やMFA等の保護を含むと述べており、安全設計を運用に結びつける姿勢が読み取れる。 (openai.com)

影響と展望

医療向けは、一般向けチャット以上に「誤りのコスト」「データ取り扱い」「監査可能性」が厳しく要求される領域である。無料提供は一見軽い施策に見えるが、実際には“現場のフィードバックが集まりやすい入口”として機能しうる。結果として、臨床文書の生成・要約・調査支援における失敗パターン(曖昧な文脈、用語の誤用、ガイドライン更新の追随など)がより早く可視化され、製品の安全・品質が改善される可能性がある。 今後は、医療機関内のワークフロー(既存EHR、院内文書、監査ログ)と統合する形で、より“業務プロセスそのもの”を置き換える方向へ進むかが注目点になる。 (openai.com)

出典

OpenAI公式ブログ「Making ChatGPT better for clinicians」

ハイライト3:OpenAI研究リリースの更新動向—プライバシーと製品統合が同時に進行

要約

OpenAIの研究/リリース一覧では、当該期間に OpenAI Privacy Filter だけでなく、GPT‑5.5等の大型アップデートや他のリリースが時系列で整理されている。つまり「プライバシー保護の基盤整備」と「モデル/プロダクト能力の拡張」が同一のリリースサイクルで並行して進んでいることが、一覧から読み取れる。 (openai.com)

背景

近年のAI開発は、単発のモデル性能向上だけで完結しない。実運用では、データ保護、評価の設計、導入のしやすさ(SDK、API、ローカル実行、監査性)など、周辺要素がプロダクトの成功確率を左右する。OpenAIの研究リリース一覧が示すのは、その“周辺要素”が研究サイドからも継続的に出てきているという点だ。 (openai.com)

技術解説

Privacy Filterは小型でローカル実行を意識し、PIIラベル体系・拘束付きデコード・ベンチマーク評価などを提示している。一方で、リスト上ではより大規模なモデルの紹介も含まれる。研究リリースの整理は、開発者が「必要な構成要素(安全・能力・評価)」を選びやすい導線になっている。 (openai.com)

影響と展望

開発者の観点では、モデル選定だけでなく「入力前処理」「出力後処理」「監査やレビュー」の部品を組み替える余地が増える。今後は、各社が“安全の部品化”をどこまで進めるかが、単なるガードレール論争ではなく実装コスト・導入スピードの差として顕在化してくる可能性がある。 (openai.com)

出典

OpenAI Research(Release Index)

3. その他のニュース

その他1:NVIDIA、NIM VLM(Visual Language Models)のEarly Accessリリースノートを更新(ドキュメント上の更新)

NVIDIAは、NIMのうちVLM向けのEarly Accessドキュメントにリリースノートページを設けており、少なくともドキュメント更新(Last updatedの表示)が行われている。導入者にとっては、早期アクセス段階での変更点(不具合修正や仕様の差分)を追跡しやすくなる点が重要だ。VLMは視覚と言語をまたぐため、デプロイ時の前提条件(入出力形式、前処理、性能)でつまずきやすい。リリースノート更新は、そうした実装上の不確実性を下げる効果が期待できる。 NVIDIA NIM for Vision Language Models(Early Access)Release Notes

その他2:NVIDIA NIM for Visual Generative AI、ドキュメント(Release Notes/Guides)を継続更新

NVIDIA NIM for Visual Generative AIのドキュメントは、モデル導入だけでなく、Air-Gapped Deployment、性能、観測(Observability)など、現場要件に直結する導線を備えている。少なくとも「Last updated」表示から、更新の継続が確認できる。生成AIを本番環境で扱う際、ネットワーク制約や運用監視(メトリクス、ログ、可観測性)が意思決定点になるため、単なるAPI提供に留まらず運用視点での整備が続いていることが読み取れる。 NVIDIA NIM for Visual Generative AI ドキュメント

その他3:Anthropic、Google Cloud Next 2026でのイベント情報を告知(公式イベントページ)

Anthropicは、Google Cloud Next 2026に関連したイベントページを公開している。イベント情報は詳細を逐一見る必要があるが、少なくとも“クラウド基盤側のエコシステムと接続する姿勢”を示すサインになる。企業ユーザーにとって、モデル提供だけでなく、クラウド上での導入・運用・連携(既存のデータ/監視/セキュリティ)をどう進めるかが現実の導入障壁になるため、こうしたイベント連携は実装ロードマップの手掛かりとして捉えられる。 Anthropic「Anthropic at Google Cloud Next 2026」

その他4:Apple ML、AIML分野の研究人材支援「Apple Scholars in AIML 2026」を発表

Apple Machine Learning Researchは「Apple Scholars in AIML」2026の受給者(PhDフェローシップ)を発表した。こうした施策は直接“モデル性能”に影響しないものの、中長期での研究人材の流入・共同研究の種になりやすい。過去のフェローが論文を生み、主要会議での受理につながっているといった文脈も示されており、研究コミュニティとの接続を維持している。AI開発の将来像は人材供給に強く依存するため、研究支援の継続性はトレンドとして追う価値がある。 Apple ML Research「Announcing the 2026 Apple Scholars in AIML」

その他5:Apple ML、ICLR 2026での研究発表・参加ハイライトを掲載

Apple Machine Learning Researchは、ICLR 2026における研究発表・スポンサーシップや関連イベントの参加などをまとめている。Appleは研究をオープンに共有しつつ、会議コミュニティでの接点を増やすスタイルを取っており、基礎研究〜実装寄りまでの幅を示すのが特徴だ。現場の開発者にとっても、次の研究トピック(例:表現学習、生成、推論、モダリティ統合など)がどの方向に伸びていくかを早めに把握できる。 Apple ML Research「Apple Machine Learning Research at ICLR 2026」

その他6:OpenAI、ChatGPT Enterprise/Eduなどプロダクト側のリリースノート更新(機能・レート等の追随)

OpenAIのHelp Centerには、ChatGPT Enterprise & EduのRelease Notesページが存在し、更新日付付きで情報が整理されている。企業や教育機関の導入では、機能差分や移行タイミング、新しい料金・レートなどが運用計画に直結するため、こうしたリリースノートの追跡は不可欠だ。今回の記事群は当日すべてを詳細に読まずとも、少なくとも“プロダクト運用の更新が継続している”ことを示す一次情報として意味がある。 OpenAI Help Center「ChatGPT Enterprise & Edu - Release Notes」

4. まとめと展望

今日の一次情報群から読み取れるのは、AIの中心が「モデルの能力」から「現場での成立条件」へ重心が移っている点だ。OpenAIのPrivacy Filterは、その代表例であり、“プライバシー保護を仕組みとして配る”方向性を明確にした。加えてChatGPT for Cliniciansの無料提供は、医療のような高コスト領域で、導入を前に進めるための足場を作る動きとして注目できる。 一方でNVIDIAはNIMのドキュメント更新を通じて、VLMや生成AIの“導入・運用の手触り”を改善している。研究コミュニティ面ではAppleが人材支援と会議参加を続け、技術の次の波を人と情報の両面から支える流れが見える。 (openai.com)

今後(短期〜数週間)に注目すべきポイントは、(1) PIIや機密情報の扱いが“モデル機能”から“周辺基盤(前処理・監査・ローカル実行)”へ置き換わっていく度合い、(2) 医療など規制・責任の重い業務で、無料・検証済み提供のような導入モデルが広がるか、(3) NIMのような運用寄りの提供形態で、VLM/生成のデプロイ体験がどれだけ改善するか、の3点である。

5. 参考文献

| タイトル | 情報源 | 日付 | URL |

|---|---|---|---|

| Introducing OpenAI Privacy Filter | OpenAI | 2026-04-22 | https://openai.com/index/introducing-openai-privacy-filter/ |

| Making ChatGPT better for clinicians | OpenAI | 2026-04-22 | https://openai.com/index/making-chatgpt-better-for-clinicians/ |

| OpenAI Research(Release Index) | OpenAI | 2026-04-23 | https://openai.com/research/index/release/ |

| Release Notes — NVIDIA NIM for Vision Language Models (VLMs) | NVIDIA | 2026-04-20 | https://docs.nvidia.com/nim/vision-language-models/early-access/release-notes.html |

| NVIDIA NIM for Visual Generative AI — Docs | NVIDIA | 2026-04-07 | https://docs.nvidia.com/nim/visual-genai/latest/index.html |

| Anthropic at Google Cloud Next 2026 | Anthropic | 2026-04-22 | https://www.anthropic.com/events/anthropic-at-google-cloud-next-2026 |

| Announcing the 2026 Apple Scholars in AIML | Apple Machine Learning Research | 2026-04-21 | https://machinelearning.apple.com/updates/apple-scholars-aiml-2026 |

| Apple Machine Learning Research at ICLR 2026 | Apple Machine Learning Research | 2026-04-22 | https://machinelearning.apple.com/research/iclr-2026 |

| ChatGPT Enterprise & Edu - Release Notes | OpenAI Help Center | 2026-04-22 | https://help.openai.com/en/articles/10128477-chatgpt-enterprise-edu-release-notes |

本記事は LLM により自動生成されたものです。内容に誤りが含まれる可能性があります。参考文献には AI が記事を生成するためにリサーチした URL を含んでいます。