1. Resumo executivo

Em 26-04-2026 (JST), a IA passou a ter como protagonista não apenas “desempenho”, mas também a estruturação de uma “operação segura que funcione no campo”. A OpenAI publicou em pesos abertos o OpenAI Privacy Filter para detecção e mascaramento (ou redação) de PII, acelerando a tendência de “incorporar a privacidade desde o início”, e não tratá-la como um complemento. Além disso, a OpenAI anunciou o ChatGPT for Clinicians com oferta gratuita (para pessoas físicas verificadas nos EUA), ampliando a porta de entrada para operações de saúde. Em paralelo, a NVIDIA atualizou documentos relacionados a VLM do NIM, fornecendo-os de modo que os adotantes possam acompanhar facilmente as mudanças.

2. Destaques de hoje

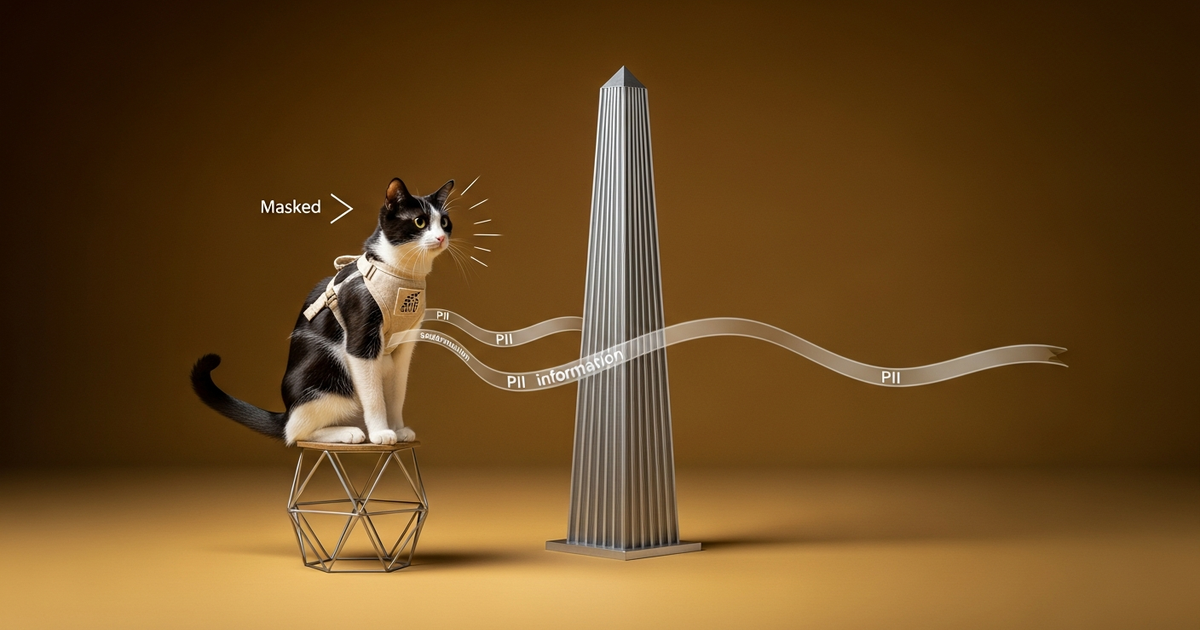

Destaque 1: OpenAI lança em pesos abertos o “OpenAI Privacy Filter” para detecção e mascaramento de PII

Resumo

A OpenAI lançou o OpenAI Privacy Filter para detectar informações pessoais (PII) em textos e mascará-las (ou aplicar redação). O destaque é que se trata de um modelo compacto pensado para execução local, que pode ser aplicado a um fluxo de trabalho de privacidade de alta vazão (throughput). Além disso, é disponibilizado sob a licença Apache 2.0, com uma arquitetura projetada para facilitar a integração do lado do desenvolvedor ao seu próprio ambiente. (openai.com)

Contexto

Com a popularização da IA generativa, aumentam os pontos por onde o texto circula — logs, bases de conhecimento, índices de busca, pipelines de aprendizado etc. Como resultado, “onde a PII se mistura e em qual etapa deve ser protegida” se torna um desafio central para o design do produto. A detecção de PII, tradicionalmente, muitas vezes adotava abordagens centradas em regras dependentes de formatos, como endereços de e-mail e números de telefone. Já na operação real, informações pessoais dependentes de contexto (como a fronteira entre informação pública e não pública, expressões ambíguas, variações de escrita) tendem a ser mais problemáticas. A OpenAI posiciona o Privacy Filter como um modelo que visa realizar julgamentos de PII “com compreensão de contexto”. (openai.com)

Explicação técnica

No Privacy Filter, segundo a descrição, é adotada a classificação de classes de tokens em ambos os sentidos (bidirecional) seguida de “span decode”, com base em um sistema de classificação por rótulos de privacidade (identificadores de identificação pessoal, contatos, endereços, datas privadas, números de conta de conta/cartão, segredos como chaves de API e senhas etc.).

Além disso, na inferência, afirma-se que será utilizado um procedimento de decodificação constrained (restrito) para converter a previsão de tokens em spans coerentes. (openai.com)

Na avaliação, a OpenAI também defende a tentativa de equilibrar “precisão” e “adaptabilidade ao campo”, com F1 (incluindo benchmark de correção) no benchmark PII-Masking-300k e melhorias por adaptação de domínio com pouca quantidade de dados. (openai.com)

Impacto e perspectivas

O impacto deste lançamento não se limita a “ter mais filtros de PII”. Como é disponibilizado em pesos abertos e pensado para execução local, as empresas conseguem incorporar a “proteção sem envio externo” com mais facilidade ao desenho. Como consequência, aumenta a liberdade para decidir onde a privacidade será garantida na arquitetura — pré-processamento do LLM (etapa de entrada), armazenamento (etapa de logs/índices), revisão (etapa de confirmação manual) etc.

No futuro, é provável que requisitos operacionais como “granularidade da detecção de PII (por span)”, “compatibilidade da especificação de mascaramento” e “auditabilidade (quando e com qual evidência a máscara foi aplicada)” se tornem eixos competitivos em um nível ainda maior, centrados no Privacy Filter. (openai.com)

Fonte

Blog oficial da OpenAI “Introducing OpenAI Privacy Filter”

Destaque 2: OpenAI oferece gratuitamente “ChatGPT for Clinicians” para profissionais de saúde (EUA, para pessoas físicas verificadas)

Resumo

A OpenAI lançou o ChatGPT for Clinicians e começou a oferecê-lo gratuitamente para profissionais de saúde individuais verificados nos EUA (médicos, NP, PA e farmacêuticos). O objetivo é apoiar tarefas relacionadas a registros (documentação) na área médica e pesquisa em saúde, aliviando a falta de tempo no ambiente clínico e a carga de trabalho de atividades administrativas e de gestão. (openai.com)

Contexto

No setor de saúde, além do atendimento em si, tarefas administrativas como registro e conformidade, bem como o acompanhamento constante de artigos médicos e diretrizes em crescimento diário, tendem a se tornar um “gargalo oculto”. A OpenAI explica esse cenário destacando a pressão exercida pelo sistema de saúde dos EUA e o fato de que profissionais da área estão voltando atenção para ferramentas de IA (no sentido de que, em uma pesquisa de 2026, houve aumento do uso por médicos). (openai.com)

Além disso, o formato de oferta — “gratuito” e “para pessoas físicas verificadas” — é explicitado com clareza, o que reduz a barreira de adoção e cria um estágio para “testar primeiro no campo”. (openai.com)

Explicação técnica

Tecnicamente, o ChatGPT for Clinicians é apresentado como um posicionamento otimizado para tarefas clínicas, com foco em apoio à criação de documentos e suporte à pesquisa médica. Adicionalmente, o artigo de lançamento inclui explicações com o modelo na família GPT‑5.4 e menciona benchmarks para tarefas de saúde (HealthBench). (openai.com)

Além disso, foi afirmado que antes do lançamento houve testes extensivos pelos assessores médicos com conversas em atividades do dia a dia (cuidado clínico, registros, pesquisa), e que o desenho não usará as conversas para aprendizado, incluindo proteções como MFA. Assim, é possível perceber a postura de conectar o design de segurança à operação. (openai.com)

Impacto e perspectivas

Em saúde, exigências como “custo de erros”, “tratamento de dados” e “auditabilidade” são mais rigorosas do que em chat geral. À primeira vista, uma oferta gratuita pode parecer uma medida leve, mas na prática pode funcionar como uma “entrada onde o feedback do campo se acumula com facilidade”. Como resultado, padrões de falha na geração e sumarização de documentos clínicos e no suporte a investigações (contexto ambíguo, uso incorreto de termos, acompanhamento de atualizações de diretrizes etc.) podem ficar visíveis mais cedo, potencialmente melhorando a segurança e a qualidade do produto.

No futuro, vale observar se haverá avanço para substituir mais “o próprio processo de trabalho” ao integrar-se ao fluxo dentro de instituições médicas (EHRs existentes, documentos internos, logs de auditoria). (openai.com)

Fonte

Blog oficial da OpenAI “Making ChatGPT better for clinicians”

Destaque 3: Atualizações de tendências em lançamentos de pesquisa da OpenAI — privacidade e integração de produto avançando ao mesmo tempo

Resumo

Na lista de pesquisa/lançamentos da OpenAI do período, OpenAI Privacy Filter não aparece sozinho: também são organizadas atualizações grandes como GPT‑5.5 e outros lançamentos por ordem cronológica. Em outras palavras, a lista permite ler que “a estruturação da base de proteção de privacidade” e “a expansão da capacidade de modelos/produtos” estão avançando paralelamente no mesmo ciclo de lançamentos. (openai.com)

Contexto

Nos últimos anos, o desenvolvimento de IA não se completa apenas com melhorias pontuais de desempenho do modelo. Em operação real, elementos adjacentes como proteção de dados, desenho de avaliação, facilidade de adoção (SDK, API, execução local, auditabilidade) etc. determinam a probabilidade de sucesso do produto. O que a lista de lançamentos de pesquisa da OpenAI mostra é que esses “elementos adjacentes” também estão surgindo continuamente no lado da pesquisa. (openai.com)

Explicação técnica

O Privacy Filter é compacto e pensado para execução local, apresentando um sistema de rótulos de PII, decodificação com restrições e avaliação por benchmark. Por outro lado, a lista também inclui a apresentação de modelos em escala maior. A organização dos lançamentos de pesquisa cria um fluxo para que desenvolvedores consigam selecionar facilmente os “componentes necessários (segurança, capacidade, avaliação)”. (openai.com)

Impacto e perspectivas

Do ponto de vista do desenvolvedor, há mais oportunidades de reorganizar não apenas a seleção do modelo, mas também os componentes de “pré-processamento”, “pós-processamento” e “auditoria/revisão”. No futuro, a forma como cada empresa avançar em “componentizar a segurança” pode se tornar evidente não como um simples debate sobre grades de proteção (guardrails), mas como diferenças de custo de implementação e velocidade de adoção. (openai.com)

Fonte

OpenAI Research (Release Index)

3. Outras notícias

Outros 1: NVIDIA atualiza notas de versão de Early Access para NIM VLM (Visual Language Models) (atualização nos documentos)

A NVIDIA criou uma página de notas de versão para os documentos de Early Access voltados a VLM dentro do NIM, com pelo menos atualização de documentação (exibição de “Last updated”). Para quem vai adotar, isso é importante porque facilita acompanhar mudanças na fase de acesso antecipado (correções de bugs e diferenças de especificação). Como VLM atravessa visão e linguagem, é fácil se deparar com dificuldades em pré-condições na implantação (formatos de entrada/saída, pré-processamento, desempenho). Espera-se que a atualização das notas de versão reduza incertezas de implementação.

NVIDIA NIM for Vision Language Models (Early Access) Release Notes

Outros 2: NVIDIA NIM for Visual Generative AI continua recebendo atualizações de documentação (Release Notes/Guides)

A documentação do NVIDIA NIM for Visual Generative AI traz trilhas diretamente relacionadas a requisitos do campo, como além da adoção de modelo, Air-Gapped Deployment, desempenho e observação (Observability). Pelo menos, a continuidade de atualizações pode ser confirmada pela exibição de “Last updated”. Ao lidar com IA generativa em ambientes de produção, restrições de rede e monitoramento operacional (métricas, logs, observabilidade) se tornam pontos de decisão, então fica claro que a preparação não fica restrita a apenas oferecer uma API — e continua sendo feita sob uma perspectiva operacional.

NVIDIA NIM for Visual Generative AI Documentação

Outros 3: Anthropic anuncia informações de eventos no Google Cloud Next 2026 (página oficial de eventos)

A Anthropic publicou uma página de eventos relacionada ao Google Cloud Next 2026. As informações do evento precisam ser verificadas em detalhes, mas, ao menos, trata-se de um sinal de que há uma “postura de conectar-se ao ecossistema do lado da infraestrutura de nuvem”. Para usuários corporativos, além de fornecer modelos, a barreira de adoção real costuma ser como avançar a adoção, operação e integração na nuvem (dados/monitoramento/segurança existentes). Por isso, essa integração de eventos pode ser vista como um ponto de partida para o roadmap de implementação.

Anthropic “Anthropic at Google Cloud Next 2026”

Outros 4: Apple ML anuncia “Apple Scholars in AIML 2026”, apoio a talentos de pesquisa na área de AIML

O Apple Machine Learning Research anunciou os bolsistas (PhD fellowships) do “Apple Scholars in AIML” 2026. Embora essas iniciativas não impactem diretamente o “desempenho do modelo”, elas costumam ser sementes para a entrada de talentos em pesquisa e para parcerias de pesquisa no médio/longo prazo. Há contexto de que fellows anteriores geraram artigos e foram aceitos em conferências principais, por exemplo, e isso indica a manutenção da conexão com a comunidade de pesquisa. Como o futuro do desenvolvimento de IA depende fortemente do fornecimento de talentos, vale acompanhar a continuidade do apoio à pesquisa como uma tendência.

Apple ML Research “Announcing the 2026 Apple Scholars in AIML”

Outros 5: Apple ML publica destaques de apresentações de pesquisa e participação no ICLR 2026

O Apple Machine Learning Research compilou informações sobre apresentações de pesquisa, patrocínios e participação em eventos relacionados no ICLR 2026. A Apple compartilha pesquisas de forma aberta e, ao mesmo tempo, adota uma postura de aumentar os pontos de contato na comunidade do encontro, mostrando uma amplitude que vai de pesquisa fundamental a temas mais próximos de implementação. Para desenvolvedores do campo, também é possível entender cedo para que direção os próximos tópicos de pesquisa (por exemplo, aprendizagem de representações, geração, raciocínio, integração de modalidades etc.) estão avançando.

Apple ML Research “Apple Machine Learning Research at ICLR 2026”

Outros 6: OpenAI atualiza notas de versão de produtos como ChatGPT Enterprise/Edu (acompanhando recursos, taxas etc.)

No Help Center da OpenAI, existe uma página de Release Notes do ChatGPT Enterprise & Edu, com informações organizadas por data de atualização. Para empresas e instituições educacionais, ao adotar, diferenças de funcionalidades e o timing de migração, além de novos preços/taxas, se conectam diretamente aos planos operacionais, tornando o acompanhamento dessas release notes indispensável. Mesmo que não se leia em detalhes todo o conjunto de artigos no dia, o material desta vez tem valor como fonte primária para indicar que “as atualizações da operação do produto continuam ocorrendo”.

OpenAI Help Center “ChatGPT Enterprise & Edu - Release Notes”

4. Conclusão e perspectivas

O que pode ser inferido do conjunto de informações primárias de hoje é que o centro da IA está mudando de “capacidade do modelo” para “condições para funcionar no campo”. O Privacy Filter da OpenAI é um exemplo representativo, deixando claro a direção de “distribuir a proteção de privacidade como um mecanismo”. Além disso, a oferta gratuita do ChatGPT for Clinicians é digna de atenção por ser um movimento que cria base para avançar a adoção em um domínio de alto custo como a medicina.

Por outro lado, a NVIDIA melhora a “sensação de adoção e operação” de VLM e IA generativa por meio de atualizações na documentação do NIM. No lado da comunidade de pesquisa, a Apple continua apoiando talentos e participando de conferências, sustentando o fluxo de apoiar a próxima onda da tecnologia tanto com pessoas quanto com informação. (openai.com)

Nos próximos períodos (curto prazo a algumas semanas), os pontos a observar são: (1) em que medida o tratamento de PII e informações confidenciais está se deslocando de “funções do modelo” para “infraestrutura adjacente (pré-processamento, auditoria, execução local)”; (2) se, em tarefas regulamentadas e com responsabilidades elevadas como a área médica, modelos de adoção como “oferta gratuita e verificada” se disseminarão; e (3) em ofertas mais orientadas à operação como as do NIM, o quanto a experiência de implantação de VLM/generação melhora.

5. Referências

| Título | Fonte de informação | Data | URL |

|---|---|---|---|

| Introducing OpenAI Privacy Filter | OpenAI | 2026-04-22 | https://openai.com/index/introducing-openai-privacy-filter/ |

| Making ChatGPT better for clinicians | OpenAI | 2026-04-22 | https://openai.com/index/making-chatgpt-better-for-clinicians/ |

| OpenAI Research(Release Index) | OpenAI | 2026-04-23 | https://openai.com/research/index/release/ |

| Release Notes — NVIDIA NIM for Vision Language Models (VLMs) | NVIDIA | 2026-04-20 | https://docs.nvidia.com/nim/vision-language-models/early-access/release-notes.html |

| NVIDIA NIM for Visual Generative AI — Docs | NVIDIA | 2026-04-07 | https://docs.nvidia.com/nim/visual-genai/latest/index.html |

| Anthropic at Google Cloud Next 2026 | Anthropic | 2026-04-22 | https://www.anthropic.com/events/anthropic-at-google-cloud-next-2026 |

| Announcing the 2026 Apple Scholars in AIML | Apple Machine Learning Research | 2026-04-21 | https://machinelearning.apple.com/updates/apple-scholars-aiml-2026 |

| Apple Machine Learning Research at ICLR 2026 | Apple Machine Learning Research | 2026-04-22 | https://machinelearning.apple.com/research/iclr-2026 |

| ChatGPT Enterprise & Edu - Release Notes | OpenAI Help Center | 2026-04-22 | https://help.openai.com/en/articles/10128477-chatgpt-enterprise-edu-release-notes |

Este artigo foi gerado automaticamente por LLM. Pode conter erros.