1. 执行摘要

截至2026-04-26(JST),AI的主角不再只是“性能”,而是“让其在现场能够安全运转的部署与运营”建设。OpenAI以开源权重发布用于PII检测与掩码的 OpenAI Privacy Filter,加速了将隐私“从一开始就纳入”而非“后续再补”的趋势。此外,OpenAI还以(面向美国经验证的个人用户的)免费形式推出 ChatGPT for Clinicians,以扩大医疗健康运营的切入点。与此同时,NVIDIA更新了NIM中与VLM相关的文档,方便导入方更容易追踪变更点。

2. 今日要点

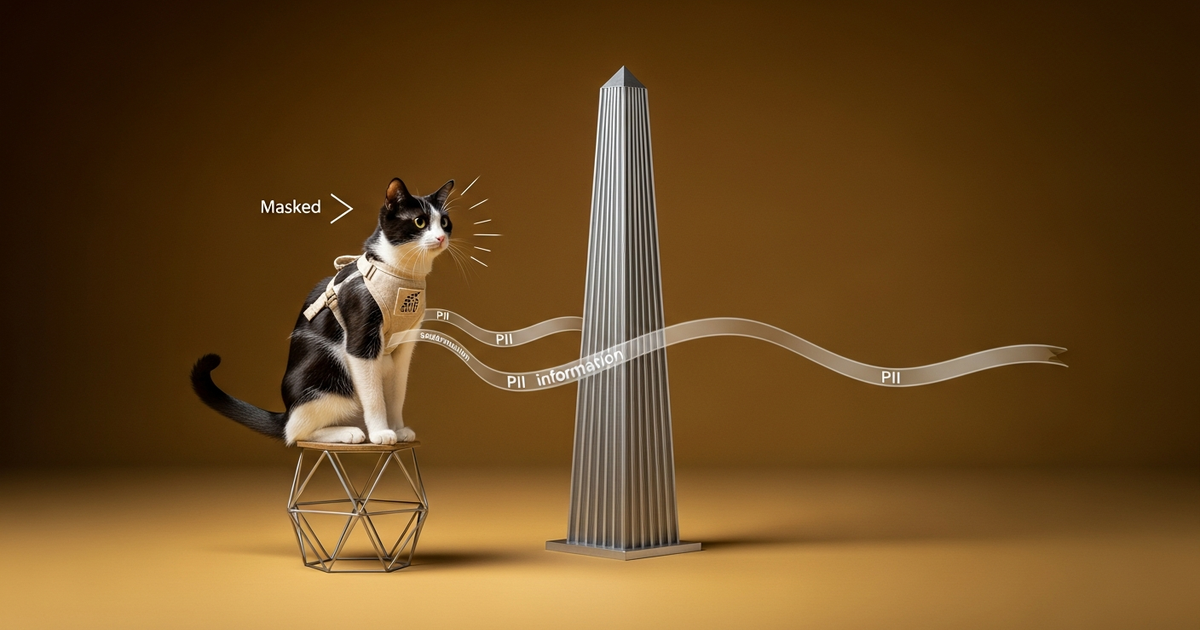

要点1:OpenAI发布面向PII检测与掩码的“OpenAI Privacy Filter”(开源权重)

概要

OpenAI发布了用于检测文本中的个人信息(PII)并进行掩码(或脱敏/重写)的 OpenAI Privacy Filter。该产品强调:它是一种面向本地运行的小型模型,可应用于高吞吐量的隐私工作流。此外,它在Apache 2.0许可协议下提供,设计上便于开发者将其集成到自家环境中。 (openai.com)

背景

随着生成AI的普及,文本流通的环节增多,例如日志、知识库、搜索索引、学习管线等。其结果是,“PII在何处混入、以及应在什么阶段进行保护”成为产品设计的核心挑战。传统的PII检测多采用依赖格式的规则导向方案,例如邮箱地址或电话号码等。另一方面,在真实运营中,语境相关的个人信息(公开信息与非公开信息的边界、含糊的表达、描述方式的差异等)更容易成为问题。OpenAI将Privacy Filter定位为旨在进行“带有语境理解”的PII判定的模型。 (openai.com)

技术解析

Privacy Filter在说明中采用“双向token类别分类 + span解码”的方式,并基于隐私标签体系对各类别进行分类(隐私标签包括个人标识符、联系方式、地址、私人日期、账户号如账户/卡号,以及诸如API密钥/密码这类秘密等)。此外,在推理时,它表示将使用一种受约束(constrained)的解码流程,以便把token预测转换为连贯的span。 (openai.com) 同时在评估方面,OpenAI通过在PII-Masking-300k基准上的F1(包含修正基准)以及通过少量数据进行领域适配带来的改进等,主张它能够在实现者期望的“精度与现场适配性”两者之间实现平衡。 (openai.com)

影响与展望

该发布的影响不仅仅在于PII过滤能力“变多了”。由于它是开源权重且面向本地运行设定,企业更容易把“无需外部发送即可实现的保护”设计进方案之中。结果是,在LLM之前处理(输入端)、存储(日志/索引端)、评审(人工确认端)等环节如何保障隐私的选择空间提升了。

未来,围绕Privacy Filter的竞争很可能会集中到诸如:PII检测的粒度(按span)、掩码规范的兼容性、可审计性(何时/基于什么依据进行了掩码)等运维需求上。 (openai.com)

参考

OpenAI官方博客《Introducing OpenAI Privacy Filter》

要点2:OpenAI面向医疗从业者免费提供“ChatGPT for Clinicians”(面向美国经验证的个人用户)

概要

OpenAI发布了 ChatGPT for Clinicians,并开始向美国境内经过验证的个人医疗从业者(医生、NP、PA、药剂师)免费提供。它旨在协助医疗领域的记录(文档编写)与医疗研究相关工作,进而缓解临床现场的时间不足与管理业务负担。 (openai.com)

背景

在医疗领域,除了诊疗本身之外,行政事务、记录与合规应对,以及日益增多的医学论文与指南追踪,都容易成为“隐性瓶颈”。OpenAI从背景上说明了:美国的医疗制度处于强压力之下、医疗从业者正在关注AI工具的使用(其含义是:在2026年的调查中,医生使用AI有所增加)。 (openai.com)

此外,其提供形态明确为“免费”“面向经验证的个人用户”,降低了导入门槛,并制造出“先在现场试用”的阶段,这一点也很突出。 (openai.com)

技术解析

从技术上看,ChatGPT for Clinicians定位为针对临床任务优化的产品;其提供内容聚焦于文档编写支持与医疗研究支持。并且,在发布文章中有关于模型(包括GPT‑5.4系)的说明,并提及医疗任务基准(HealthBench)。 (openai.com)

此外,文章还称:在发布前,医疗顾问已在日常工作(临床护理、记录、研究)中对大量对话进行了测试,并且还包含“对话不用于训练”的设计以及诸如MFA等保护措施。可以从中看出其将安全设计与运营落地相连接的态度。 (openai.com)

影响与展望

面向医疗的场景,相比面向大众的聊天,更严苛地要求“错误的成本”“数据处理”“可审计性”。表面上免费提供看起来是一种轻量举措,但实际上它可能作为“更容易收集到现场反馈的入口”发挥作用。结果是,在临床文档生成、摘要、调研支持等方面的失败模式(模糊的语境、术语误用、对指南更新的追随滞后等)更早被显性化,从而有可能提升产品的安全性与质量。

未来,值得关注的是:是否会以集成到医疗机构内部工作流(现有EHR、院内文档、审计日志)的方式,朝着“替换业务流程本身”的方向推进。 (openai.com)

参考

OpenAI官方博客《Making ChatGPT better for clinicians》

要点3:OpenAI研究发布的更新动向——隐私与产品集成同步推进

概要

在OpenAI的研究/发布列表中,在该时间段内不仅有 OpenAI Privacy Filter,还按时间顺序整理了诸如GPT‑5.5等大型更新以及其他发布。也就是说,从列表中可以读出:围绕“隐私保护基础设施的建设”和“模型/产品能力的扩展”在同一个发布周期内并行推进。 (openai.com)

背景

近年来的AI开发并不能仅靠单次的模型性能提升就完成。在实际运营中,数据保护、评估设计、易于导入(SDK、API、本地运行、可审计性)等周边要素会显著影响产品成功概率。OpenAI的研究发布列表所呈现的是:这些“周边要素”也在持续地从研究侧被提出。 (openai.com)

技术解析

Privacy Filter面向小型化与本地运行,提供了PII标签体系、受约束解码、基准评估等内容。另一方面,列表中也包含对更大规模模型的介绍。对研究发布的整理,使开发者更容易选择所需的构成要素(安全、能力、评估)。 (openai.com)

影响与展望

从开发者视角来看,除了模型选择之外,“输入前处理”“输出后处理”“审计与评审”的组件可重新组合的空间增大了。未来,各公司推进“安全组件化”的程度差异,可能不会仅停留在“护栏争论”层面,而会逐渐以实现成本与导入速度的差异形式显性化。 (openai.com)

参考

OpenAI Research(Release Index)

3. 其他新闻

其他1:NVIDIA更新NIM VLM(Visual Language Models)的Early Access发布说明(文档更新)

NVIDIA为NIM中面向VLM的Early Access文档设置了发布说明页面,至少进行了文档更新(显示Last updated)。对导入者而言,这一点很重要:在早期访问阶段,变更点(例如修复了的缺陷或规范差异)更易追踪。由于VLM横跨视觉与语言,部署时在前提条件(输入/输出格式、前处理、性能)上容易绊倒。更新发布说明有望降低此类实现上的不确定性。 NVIDIA NIM for Vision Language Models(Early Access)Release Notes

其他2:NVIDIA NIM for Visual Generative AI持续更新文档(Release Notes/Guides)

NVIDIA NIM for Visual Generative AI 的文档不仅覆盖模型导入,还具备与现场需求直接相关的路径,例如Air-Gapped Deployment、性能、观测(Observability)等。至少从“Last updated”的显示可以确认持续在更新。由于在将生成AI用于生产环境时,网络约束与运维监控(指标、日志、可观测性)会成为决策点,因此可以看出其并未停留在单纯的API提供,而是在持续从运维视角完善。 NVIDIA NIM for Visual Generative AI 文档

其他3:Anthropic预告将在Google Cloud Next 2026举办的活动信息(官方活动页面)

Anthropic发布了与Google Cloud Next 2026相关的活动页面。虽然需要逐条查看活动细节,但至少这是一个“展示与云基础设施侧生态系统连接姿态”的信号。对于企业用户而言,导入障碍往往会落在:不仅仅是模型提供,而是如何在云端推进导入、运行与集成(现有数据/监控/安全等)。因此,这类活动联动可以被视为实现路线图的线索。 Anthropic《Anthropic at Google Cloud Next 2026》

其他4:Apple ML宣布支持AIML领域研究人才的“Apple Scholars in AIML 2026”

Apple Machine Learning Research公布了“Apple Scholars in AIML”2026的受资者(PhD奖学金)。这类举措虽然不会直接影响“模型性能”,但在中长期更可能成为研究人才的流入与联合研究的种子。过去的奖学金获得者产出论文并在主要会议中获得接收的语境也有所体现,并且表明其与研究社区维系连接。由于AI开发的未来图景高度依赖人才供给,因此值得把握研究支持的持续性作为一种趋势进行关注。 Apple ML Research《Announcing the 2026 Apple Scholars in AIML》

其他5:Apple ML刊登ICLR 2026的研究发布与参与亮点

Apple Machine Learning Research汇总了其在ICLR 2026上的研究发布、赞助与参与相关活动等信息。Apple在开放共享研究的同时,也通过增加其在会议社区中的接触来采取一种风格,呈现出从基础研究到更偏实现的一系列范围。对一线开发者而言,也能更早把握下一个研究主题(例如表征学习、生成、推理、模态整合等)将朝哪些方向发展。 Apple ML Research《Apple Machine Learning Research at ICLR 2026》

其他6:OpenAI更新产品侧(ChatGPT Enterprise/Edu等)的发布说明(功能、费率等的追随)

OpenAI的Help Center中存在ChatGPT Enterprise & Edu的Release Notes页面,并按更新日期整理信息。在企业与教育机构导入时,功能差异、迁移时机以及新的价格与费率等会直接关联到运营计划,因此追踪此类发布说明是必不可少的。这组文章即使不需要在当日逐条深入阅读,也至少具有作为“一手信息”的意义:表明“产品运营更新正在持续发生”。 OpenAI Help Center《ChatGPT Enterprise & Edu - Release Notes》

4. 总结与展望

从今日的一手信息中可以看出:AI的重心正从“模型能力”转向“让其在现场成立的条件”。OpenAI的Privacy Filter就是一个典型例子,它明确了一个方向:把隐私保护作为一种机制“分发/配套”。此外,ChatGPT for Clinicians的免费提供也值得关注——它是在高成本领域(医疗)中为推进导入构建支点。

另一方面,NVIDIA通过更新NIM文档改善了VLM与生成AI的“导入与运维的手感”。在研究社区层面,Apple持续进行人才支持与会议参与,能够看到其从人和信息两方面为技术下一波提供支撑的路径。 (openai.com)

未来(短期至数周)值得关注的重点是三个方面: (1) PII与机密信息的处理正在以何种程度从“模型功能”转向“周边基础设施(前处理、审计、本地运行)”; (2) 在医疗等监管与责任较重的工作中,类似“免费且经过验证的提供模式”是否会扩散; (3) 在类似NIM这种更偏运维导向的提供形态下,VLM/生成的部署体验将改善到何种程度。

5. 参考文献

| 标题 | 信息源 | 日期 | URL |

|---|---|---|---|

| Introducing OpenAI Privacy Filter | OpenAI | 2026-04-22 | https://openai.com/index/introducing-openai-privacy-filter/ |

| Making ChatGPT better for clinicians | OpenAI | 2026-04-22 | https://openai.com/index/making-chatgpt-better-for-clinicians/ |

| OpenAI Research(Release Index) | OpenAI | 2026-04-23 | https://openai.com/research/index/release/ |

| Release Notes — NVIDIA NIM for Vision Language Models (VLMs) | NVIDIA | 2026-04-20 | https://docs.nvidia.com/nim/vision-language-models/early-access/release-notes.html |

| NVIDIA NIM for Visual Generative AI — Docs | NVIDIA | 2026-04-07 | https://docs.nvidia.com/nim/visual-genai/latest/index.html |

| Anthropic at Google Cloud Next 2026 | Anthropic | 2026-04-22 | https://www.anthropic.com/events/anthropic-at-google-cloud-next-2026 |

| Announcing the 2026 Apple Scholars in AIML | Apple Machine Learning Research | 2026-04-21 | https://machinelearning.apple.com/updates/apple-scholars-aiml-2026 |

| Apple Machine Learning Research at ICLR 2026 | Apple Machine Learning Research | 2026-04-22 | https://machinelearning.apple.com/research/iclr-2026 |

| ChatGPT Enterprise & Edu - Release Notes | OpenAI Help Center | 2026-04-22 | https://help.openai.com/en/articles/10128477-chatgpt-enterprise-edu-release-notes |

本文由 LLM 自动生成,内容可能存在错误。