1. Resumen ejecutivo

A lo largo del 26-04-2026 (JST), la IA ha pasado a tener como protagonista no solo la “rendición de cuentas por rendimiento”, sino la preparación de la “seguridad y operación que funciona en el terreno”. OpenAI publicó OpenAI Privacy Filter open-weight para detección y enmascaramiento (u “redacción”) de PII, acelerando la tendencia de integrar la privacidad “desde el principio” en lugar de tratarla como un añadido posterior. Además, OpenAI presenta el ChatGPT for Clinicians como una oferta gratuita (para individuos verificados en EE. UU.), ampliando la entrada a las operaciones en el ámbito de la salud. En paralelo, NVIDIA actualizó la documentación relacionada con VLM de NIM, ofreciéndola en un formato que facilita a quienes lo implementan seguir los cambios.

2. Aspectos destacados de hoy

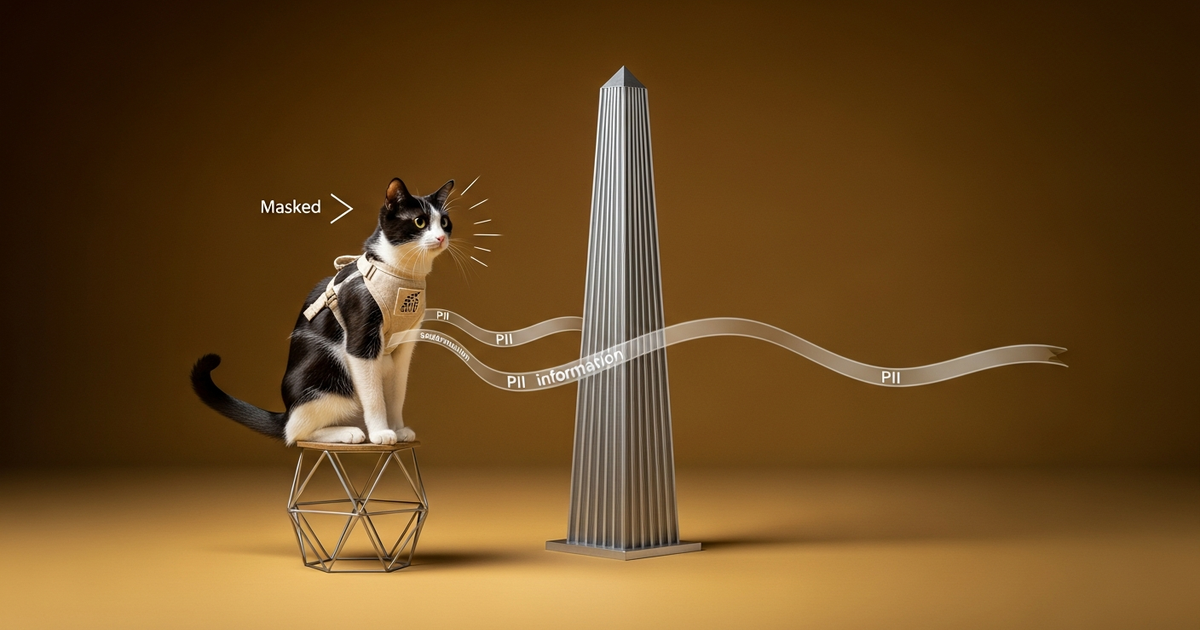

Destacado 1: OpenAI lanza en open-weight el “OpenAI Privacy Filter” para detección y enmascaramiento de PII

Resumen

OpenAI lanzó OpenAI Privacy Filter para detectar información personal (PII) en textos y enmascararla (o redactarla). Destaca que es un modelo pequeño pensado para ejecución local y que puede aplicarse a flujos de trabajo de privacidad de alto rendimiento. Además, se ofrece bajo licencia Apache 2.0, con un diseño que facilita que los desarrolladores lo integren en sus propios entornos. (openai.com)

Contexto

Con la popularización de la IA generativa, han aumentado los lugares por donde circula texto, como registros (logs), bases de conocimientos, índices de búsqueda y tuberías de entrenamiento. Como resultado, “dónde se mezcla PII y en qué etapa debe protegerse” se ha convertido en un problema central para el diseño de productos. La detección de PII tradicional suele basarse en reglas centradas en formatos (por ejemplo, direcciones de correo electrónico y números de teléfono). En cambio, en el uso real, suelen surgir problemas con información personal dependiente del contexto (fronteras entre información pública y no pública, formulaciones ambiguas, variaciones en cómo se escribe, etc.). OpenAI posiciona Privacy Filter como un modelo orientado a realizar juicios de PII “con comprensión del contexto”. (openai.com)

Explicación técnica

Según la descripción, Privacy Filter emplea “clasificación de clases de tokens en ambas direcciones + decodificación de spans con restricciones”. Se basa en una taxonomía de clasificación por etiquetas de privacidad (identificadores personales, contactos, direcciones, fechas privadas, números de cuenta de cuentas/tarjetas, secretos como claves de API y contraseñas, etc.). Además, en la inferencia afirma usar un procedimiento de decodificación con restricciones (constrained) para convertir la predicción de tokens en spans coherentes. (openai.com) También, en el apartado de evaluación, argumenta la necesidad de equilibrar “precisión y adaptabilidad al entorno real” mediante F1 (incluido el benchmark de corrección) en el benchmark PII-Masking-300k y mejoras por adaptación de dominio con pocos datos. (openai.com)

Impacto y perspectivas

El impacto de este lanzamiento no se limita a que haya más filtros de PII. Al tratarse de open-weight y estar pensado para ejecución local, las empresas pueden incorporar un “mecanismo de protección sin envío externo” dentro del diseño. Como resultado, aumenta la libertad para decidir en qué puntos de la arquitectura se garantiza la privacidad: preprocesamiento antes del LLM (entrada), almacenamiento (logs/etapas de indexación), revisión (confirmación manual), etc. En el futuro, es probable que los requisitos operativos como (1) el nivel de granularidad de la detección de PII (a nivel de span), (2) la compatibilidad de las especificaciones de enmascaramiento y (3) la auditabilidad (cuándo y con qué base se enmascaró) se conviertan en el eje competitivo. (openai.com)

Fuente

Blog oficial de OpenAI “Introducing OpenAI Privacy Filter”

Destacado 2: OpenAI ofrece gratuitamente “ChatGPT for Clinicians” dirigido a profesionales de la salud (para individuos verificados en EE. UU.)

Resumen

OpenAI lanzó ChatGPT for Clinicians y comenzó a ofrecerlo de forma gratuita a profesionales de salud individuales verificados (médicos, NP, PA y farmacéuticos) dentro de EE. UU. El objetivo es ayudar con tareas relacionadas con registros (documentación) e investigación médica, aliviando la falta de tiempo y la carga de trabajo de gestión en el entorno clínico. (openai.com)

Contexto

En el ámbito de la salud, además de la atención médica en sí, las tareas administrativas, la documentación, la respuesta a la conformidad (compliance) y el seguimiento constante de artículos médicos y guías que no paran de crecer tienden a convertirse en “cuellos de botella ocultos”. OpenAI explica este contexto señalando la fuerte presión bajo la que opera el sistema sanitario estadounidense y que los profesionales de salud están prestando atención a herramientas de IA (en el sentido de que en una encuesta de 2026 aumentó el uso por parte de médicos). (openai.com) Además, como forma de provisión define explícitamente “gratis” y “para individuos verificados”, reduciendo la barrera de adopción y creando una etapa en la que pueden “probarlo primero en el terreno”. (openai.com)

Explicación técnica

Técnicamente, ChatGPT for Clinicians se posiciona como una oferta optimizada para tareas clínicas, y el contenido se centra en asistencia para redacción de documentos y apoyo para investigación médica. Además, el artículo de lanzamiento incluye explicaciones que abarcan una familia de modelos GPT‑5.4 e indica el benchmark de tareas médicas (HealthBench). (openai.com) Asimismo, señala que antes del lanzamiento se realizaron múltiples pruebas de conversaciones con asesores clínicos en actividades diarias (atención clínica, documentación e investigación), y que el diseño evita que las conversaciones se usen para entrenamiento, incluyendo salvaguardas como MFA. Esto refleja una postura de conectar la seguridad con la operación. (openai.com)

Impacto y perspectivas

En salud, se exigen con mucha más rigurosidad que en chats para el público general “el costo de cometer errores”, el “manejo de datos” y la “auditabilidad”. Aunque la oferta gratuita pueda parecer una medida ligera, en realidad puede funcionar como una “puerta de entrada” donde es más fácil recopilar retroalimentación del entorno real. Como resultado, es posible que los patrones de fallo (contexto ambiguo, uso incorrecto de términos, seguimiento de actualizaciones de guías, etc.) en la generación de documentos clínicos, resúmenes y apoyo a la investigación se hagan visibles antes, mejorando así la seguridad y la calidad del producto. En el futuro, será clave observar si avanzan hacia reemplazar “el propio proceso de trabajo” integrándolo con flujos de trabajo dentro de instituciones médicas (EHR existentes, documentos internos, logs de auditoría, etc.). (openai.com)

Fuente

Blog oficial de OpenAI “Making ChatGPT better for clinicians”

Destacado 3: Tendencias de actualización en lanzamientos de investigación de OpenAI—avanza simultáneamente la privacidad y la integración al producto

Resumen

En la lista de investigación/lanzamientos de OpenAI, para el periodo correspondiente se organizan no solo OpenAI Privacy Filter, sino también grandes actualizaciones como GPT‑5.5, y otros lanzamientos en orden cronológico. Es decir, a partir de la lista se puede leer que “la preparación de la base de protección de privacidad” y “la expansión de capacidades del modelo/producto” se desarrollan en paralelo dentro del mismo ciclo de lanzamiento. (openai.com)

Contexto

En los últimos años, el desarrollo de IA no termina en una mejora puntual del rendimiento del modelo. En la operación real, elementos periféricos como la protección de datos, el diseño de la evaluación, la facilidad de adopción (SDK, API, ejecución local, auditabilidad) determinan la probabilidad de éxito del producto. Lo que muestra la lista de lanzamientos de investigación de OpenAI es que esos “elementos periféricos” siguen apareciendo de manera continua también desde el lado de investigación. (openai.com)

Explicación técnica

Privacy Filter es pequeño y está pensado para ejecución local, presentando un sistema de etiquetas PII, decodificación con restricciones y evaluación mediante benchmarks, entre otros. En cambio, en la lista también se incluyen presentaciones de modelos más grandes. La organización de los lanzamientos de investigación crea una ruta para que los desarrolladores puedan seleccionar con facilidad los “componentes necesarios” (seguridad, capacidades y evaluación). (openai.com)

Impacto y perspectivas

Desde la perspectiva del desarrollo, se amplía el margen para recombinar no solo la selección del modelo, sino también piezas como “preprocesamiento antes de la entrada”, “postprocesamiento de la salida” y “auditoría o revisión”. A futuro, el grado en que cada empresa avance hacia la “componentización de la seguridad” podría hacerse visible no como una mera controversia sobre carriles de protección, sino como una diferencia en costos de implementación y velocidad de adopción. (openai.com)

Fuente

OpenAI Research (Release Index)

3. Otras noticias

Otras1: NVIDIA actualiza las notas de lanzamiento (release notes) de Early Access de NIM VLM (Visual Language Models) (actualización en la documentación)

NVIDIA ha creado una página de release notes para la documentación de Early Access orientada a VLM dentro de NIM, y al menos se ha realizado una actualización de la documentación (como la visualización de Last updated). Para quienes lo implementan, esto es importante porque les permite dar seguimiento con facilidad a los cambios en la fase de acceso temprano (correcciones de fallos o diferencias de especificación). Como VLM cruza lo visual y el lenguaje, al implementar suelen tropezarse con condiciones previas (formatos de entrada/salida, preprocesamiento, rendimiento). Se espera que la actualización de las release notes reduzca esa incertidumbre de implementación. NVIDIA NIM for Vision Language Models (Early Access) Release Notes

Otras2: NVIDIA NIM for Visual Generative AI continúa actualizando documentación (Release Notes/Guides)

La documentación de NVIDIA NIM for Visual Generative AI no solo incluye la incorporación del modelo, sino que también incorpora rutas conectadas a requisitos del entorno como Air-Gapped Deployment, rendimiento y Observability. Al menos, puede confirmarse la continuidad de las actualizaciones a partir de la indicación de “Last updated”. Al manejar IA generativa en un entorno productivo, las restricciones de red y la supervisión operativa (métricas, logs, observabilidad) se vuelven puntos de decisión, por lo que se aprecia que se mantiene la preparación desde la perspectiva de operación, y no se limita solo a ofrecer una API. NVIDIA NIM for Visual Generative AI Documentación

Otras3: Anthropic anuncia información de eventos en Google Cloud Next 2026 (página oficial de eventos)

Anthropic publica una página de eventos relacionada con Google Cloud Next 2026. Aunque la información del evento requiere revisar los detalles uno a uno, al menos sirve como una señal de “actitud de conexión con el ecosistema del lado de la infraestructura cloud”. Para usuarios empresariales, la barrera real de adopción suele estar en cómo avanzar la adopción, operación e integración en la nube (datos/monitorización/seguridad existentes), más allá de solo recibir modelos. Por ello, esta coordinación de eventos puede interpretarse como una pista para el roadmap de implementación. Anthropic “Anthropic at Google Cloud Next 2026”

Otras4: Apple ML anuncia “Apple Scholars in AIML 2026”, apoyo a talento investigador en el área de AIML

Apple Machine Learning Research anunció a los destinatarios (becas PhD) de “Apple Scholars in AIML” 2026. Aunque estas iniciativas no impactan directamente en el “rendimiento del modelo”, suelen convertirse en semillas para el flujo de talento en el largo plazo y para la colaboración en investigación. Enmarcado así, se muestra que los fellows del pasado producen artículos y se relaciona con la aceptación en conferencias principales, manteniendo la conexión con la comunidad de investigación. Dado que el futuro del desarrollo de IA depende fuertemente del suministro de talento, vale la pena seguir la continuidad del apoyo a la investigación como tendencia. Apple ML Research “Announcing the 2026 Apple Scholars in AIML”

Otras5: Apple ML publica destacados de presentaciones e interacción en ICLR 2026

Apple Machine Learning Research recopila información sobre presentaciones de investigación en ICLR 2026, patrocinio y participación en eventos relacionados. Apple comparte abiertamente su investigación y, al mismo tiempo, aumenta los puntos de contacto con la comunidad del congreso adoptando un estilo que incrementa esas conexiones. Esto se caracteriza por mostrar un espectro desde investigación básica hasta enfoques más cercanos a la implementación. Para desarrolladores en el terreno, también permite anticipar hacia dónde se expandirán los próximos temas de investigación (por ejemplo: aprendizaje de representaciones, generación, inferencia e integración de modalidades). Apple ML Research “Apple Machine Learning Research at ICLR 2026”

Otras6: OpenAI actualiza release notes de productos como ChatGPT Enterprise/Edu (seguimiento de funciones, tarifas, etc.)

En el Help Center de OpenAI existe una página de Release Notes para ChatGPT Enterprise & Edu, con la información organizada junto con las fechas de actualización. En adopciones por parte de empresas e instituciones educativas, las diferencias de funciones, los momentos de migración y los nuevos precios/tarifas se conectan directamente con el plan operativo, por lo que el seguimiento de estas release notes es imprescindible. El conjunto de artículos de esta ocasión tiene valor como fuente primaria que demuestra, al menos, que “la actualización del funcionamiento del producto continúa”, aunque no se lean en detalle todos los artículos del día. OpenAI Help Center “ChatGPT Enterprise & Edu - Release Notes”

4. Resumen y perspectivas

Lo que se puede leer a partir de los conjuntos de información primaria de hoy es que el centro de la IA está desplazándose desde “la capacidad del modelo” hacia “las condiciones para que funcione en el terreno”. Privacy Filter de OpenAI es un ejemplo representativo: deja clara la dirección de “repartir la protección de la privacidad como un mecanismo”. Además, la oferta gratuita de ChatGPT for Clinicians es una señal a destacar como movimiento para construir una base que permita avanzar en la adopción en un área de alto costo como la salud. Por otro lado, NVIDIA, mediante actualizaciones de documentación de NIM, mejora la “sensación de adopción y operación” para VLM y la IA generativa. En el lado de la comunidad de investigación, Apple continúa con apoyo a talento y participación en conferencias, mostrando un flujo que sostiene el próximo auge de la tecnología tanto desde la perspectiva de personas como de información. (openai.com)

En el futuro (en el corto plazo a unas pocas semanas), los puntos que conviene vigilar son: (1) en qué medida el manejo de PII y de información confidencial se está trasladando de “funcionalidad del modelo” hacia “infraestructura periférica (preprocesamiento, auditoría, ejecución local)”, (2) si en trabajos con regulaciones y responsabilidades elevadas como el ámbito médico se amplían los modelos de adopción como la oferta gratuita y verificada, y (3) en un modelo de provisión orientado a operación como NIM, cuánto mejora la experiencia de despliegue de VLM/generación.

5. Referencias

| Título | Fuente de información | Fecha | URL |

|---|---|---|---|

| Introducing OpenAI Privacy Filter | OpenAI | 2026-04-22 | https://openai.com/index/introducing-openai-privacy-filter/ |

| Making ChatGPT better for clinicians | OpenAI | 2026-04-22 | https://openai.com/index/making-chatgpt-better-for-clinicians/ |

| OpenAI Research (Release Index) | OpenAI | 2026-04-23 | https://openai.com/research/index/release/ |

| Release Notes — NVIDIA NIM for Vision Language Models (VLMs) | NVIDIA | 2026-04-20 | https://docs.nvidia.com/nim/vision-language-models/early-access/release-notes.html |

| NVIDIA NIM for Visual Generative AI — Docs | NVIDIA | 2026-04-07 | https://docs.nvidia.com/nim/visual-genai/latest/index.html |

| Anthropic at Google Cloud Next 2026 | Anthropic | 2026-04-22 | https://www.anthropic.com/events/anthropic-at-google-cloud-next-2026 |

| Announcing the 2026 Apple Scholars in AIML | Apple Machine Learning Research | 2026-04-21 | https://machinelearning.apple.com/updates/apple-scholars-aiml-2026 |

| Apple Machine Learning Research at ICLR 2026 | Apple Machine Learning Research | 2026-04-22 | https://machinelearning.apple.com/research/iclr-2026 |

| ChatGPT Enterprise & Edu - Release Notes | OpenAI Help Center | 2026-04-22 | https://help.openai.com/en/articles/10128477-chatgpt-enterprise-edu-release-notes |

Este artículo fue generado automáticamente por LLM. Puede contener errores.